Искусственный интеллект в медицине перестал быть темой «на будущее». В 2026 году обсуждение стало гораздо практичнее: не заменит ли ИИ врача, а где именно он может снизить риск ошибки, расширить дифференциальный диагноз и помочь в принятии решений.

Одно из самых заметных исследований года, опубликованное в Science, сравнило большую языковую модель с врачами на задачах клинического мышления: постановка дифференциального диагноза, выбор дальнейших шагов, анализ сложных случаев и работа с реальными данными из отделения неотложной помощи.

Результат оказался сильным: в ряде текстовых клинических задач ИИ показал уровень, сопоставимый с врачами или выше. Но главный вывод исследования совсем не в том, что врача можно заменить. Напротив: чем мощнее становятся модели, тем важнее правильно встроить их в клинический процесс.

Что именно изменилось

Раньше медицинские ИИ-системы чаще оценивали по экзаменационным вопросам и тестам с вариантами ответов. Это удобно для сравнения, но плохо отражает реальную клинику.

Врач работает иначе:

- собирает неполные данные;

- уточняет анамнез;

- оценивает внешний вид пациента;

- видит динамику состояния;

- учитывает контекст, тревогу, боль, поведение;

- принимает ответственность за решение.

Исследования 2026 года сдвинули фокус: теперь ИИ всё чаще проверяют не на тестах, а на задачах, похожих на реальное клиническое мышление.

Где ИИ оказался особенно полезен

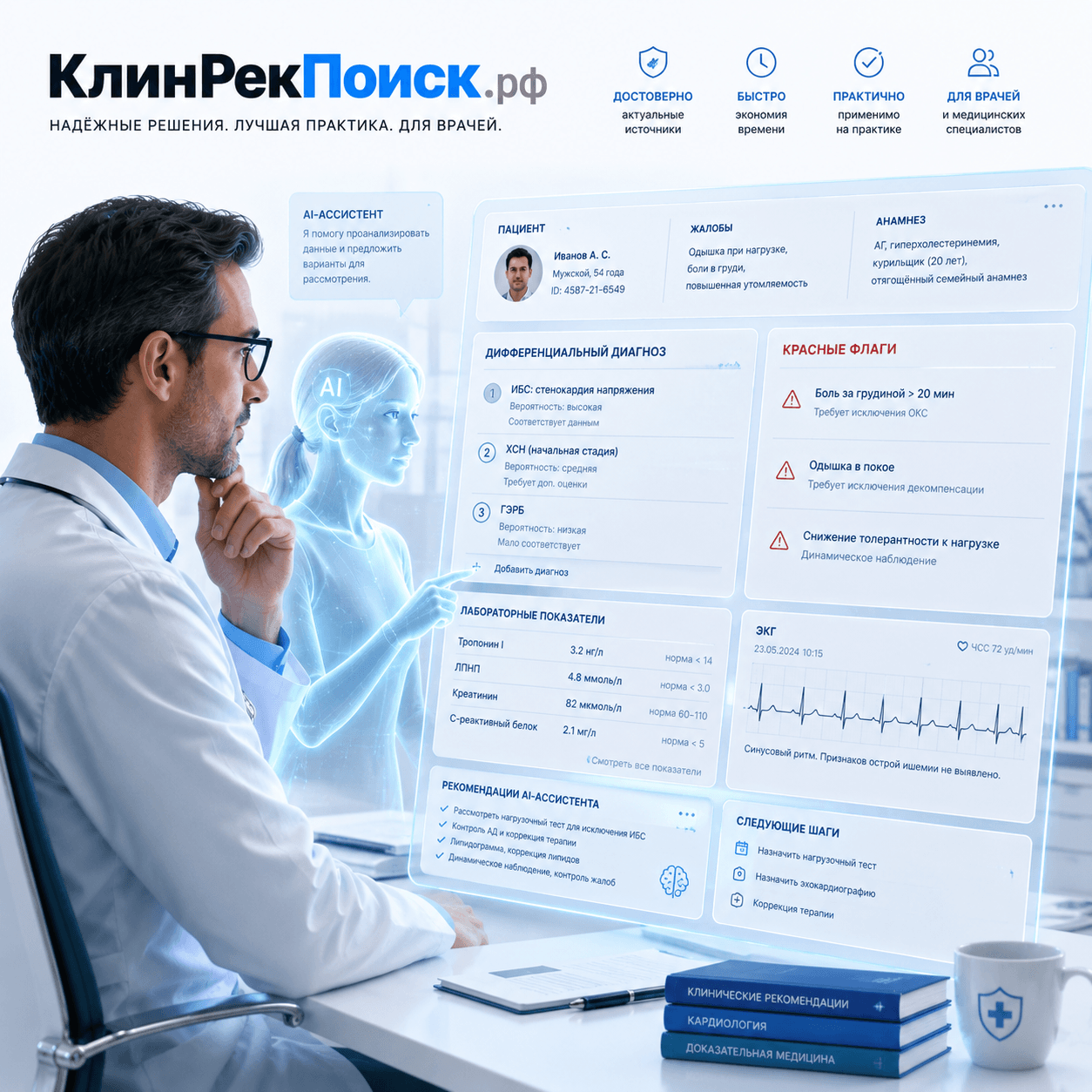

Самая сильная сторона современных моделей — работа с текстом и большим количеством разрозненной информации.

ИИ может быть полезен, когда врачу нужно:

- быстро сформировать широкий дифференциальный диагноз;

- не пропустить редкую, но важную причину симптомов;

- сопоставить жалобы, анамнез, лабораторные данные и выписку;

- предложить, какие данные стоит уточнить;

- напомнить о «красных флагах»;

- подготовить черновик клинического рассуждения;

- структурировать сложный случай для консультации.

То есть ИИ хорошо подходит не на роль «автопилота», а на роль внимательного ассистента, который помогает врачу посмотреть на случай под другим углом.

Почему это важно именно врачу

В клинической практике ошибки часто возникают не из-за незнания, а из-за перегрузки, усталости и когнитивных ловушек.

Например:

- диагноз кажется очевидным слишком рано;

- врач якорится на первой гипотезе;

- редкая причина не попадает в дифференциальный ряд;

- важная деталь теряется в длинной истории болезни;

- решение принимается в условиях дефицита времени.

В таких ситуациях ИИ может быть полезен как инструмент проверки мышления.

Не вместо вопроса «что я думаю?», а рядом с ним:

«что я мог упустить?»

Но есть важное ограничение

ИИ может хорошо рассуждать по тексту, но это не равно клинической безопасности.

Он не видит пациента.

Не пальпирует живот.

Не оценивает одышку у двери кабинета.

Не слышит тревогу родственников.

Не несёт юридическую и этическую ответственность.

И может уверенно ошибаться.

Поэтому даже сильные результаты исследований не означают, что модель можно допустить к самостоятельной диагностике или лечению.

Правильная формула на сегодня:

ИИ помогает думать, но решение принимает врач.

Как врачу использовать ИИ безопаснее

Если врач использует ИИ как справочный или аналитический инструмент, лучше относиться к нему не как к источнику истины, а как к дополнительному собеседнику.

Практически это может выглядеть так:

1. Сначала сформулировать собственную клиническую гипотезу.

2. Затем попросить ИИ предложить альтернативный дифференциальный диагноз.

3. Проверить, нет ли среди вариантов опасных состояний, которые нельзя пропустить.

4. Сверить предложения с клиническими рекомендациями, локальными протоколами и доступными обследованиями.

5. Не переносить ответ ИИ в документацию без врачебной проверки.

6. Не вводить персональные данные пациента в небезопасные внешние сервисы.

Главная ошибка — начинать думать с ответа модели.

Гораздо безопаснее использовать её после собственного клинического анализа.

Хороший запрос к ИИ

Вместо короткого вопроса:

«Что у пациента?»

лучше формулировать задачу так:

«Пациент 58 лет, боль в груди, одышка, гипертония в анамнезе, ЭКГ без подъёма ST, тропонин ожидается. Составь дифференциальный диагноз, выдели состояния, которые нельзя пропустить, и укажи, какие данные нужно уточнить. Не ставь окончательный диагноз».

Такой формат снижает риск ложной уверенности и помогает получить не готовое решение, а структуру для врачебного мышления.

Где ИИ может быть особенно ценен

Неотложная помощь

В отделении неотложной помощи ИИ может помогать расширять дифференциальный диагноз на раннем этапе, когда данных ещё мало. Особенно это важно при неспецифических жалобах: слабость, боль в груди, одышка, спутанность сознания, боль в животе.

Амбулаторный приём

На приёме ИИ может помочь структурировать длинный анамнез, выделить факторы риска, подготовить список уточняющих вопросов и напомнить о показаниях к дообследованию.

Консилиумы и сложные пациенты

При мультиморбидности модель может быть полезна как инструмент предварительной систематизации: собрать проблемы, лекарства, риски взаимодействий и возможные направления поиска.

Обучение врачей

Для ординаторов и молодых специалистов ИИ может стать тренажёром клинического мышления: объяснять дифференциальный диагноз, сравнивать гипотезы и показывать, какие данные усиливают или ослабляют каждую версию.

Где нужна особая осторожность

ИИ не должен использоваться как самостоятельный источник решений в ситуациях, где цена ошибки особенно высока.

К таким ситуациям относятся:

- нестабильный пациент;

- реанимационные решения;

- назначение потенциально опасной терапии;

- интерпретация данных без клинического контекста;

- педиатрия, беременность, онкология, психиатрия;

- пациенты с атипичными проявлениями;

- случаи, где важны локальные протоколы и маршрутизация.

В этих сценариях ИИ может быть только вспомогательным инструментом, а не основанием для действия.

Что это меняет в профессии

ИИ не отменяет клиническое мышление. Он повышает требования к нему.

Врачу становится важно не просто знать ответ, а уметь:

- правильно задать вопрос;

- отличить разумную подсказку от красивой ошибки;

- проверить источник;

- оценить применимость к конкретному пациенту;

- объяснить решение пациенту и коллегам;

- сохранить ответственность за итоговую тактику.

Именно поэтому сильный врач с ИИ может стать эффективнее, а слабая клиническая логика с ИИ — опаснее.

Главное для практики

Исследования 2026 года показывают: современные языковые модели уже способны конкурировать с врачами в отдельных задачах клинического reasoning, особенно при работе с текстовыми случаями и дифференциальной диагностикой.

Но медицина — это не только текстовая задача. Это пациент, осмотр, динамика, неопределённость, ответственность и коммуникация.

Поэтому наиболее реалистичный сценарий ближайших лет — не «ИИ вместо врача», а врач плюс ИИ как второе мнение.

Самый полезный вопрос, который врач может задать такой системе:

«Что я мог не учесть?»

И самый важный ответ, который врач должен оставить за собой:

«Что я буду делать с этим пациентом сейчас?»